Agent 评估 Benchmarks

📅 发表于 2025/05/14

🔄 更新于 2025/05/14

👁️ -- 次访问

📝 0 字

⏳ 0 分钟

agent

#agent evalution

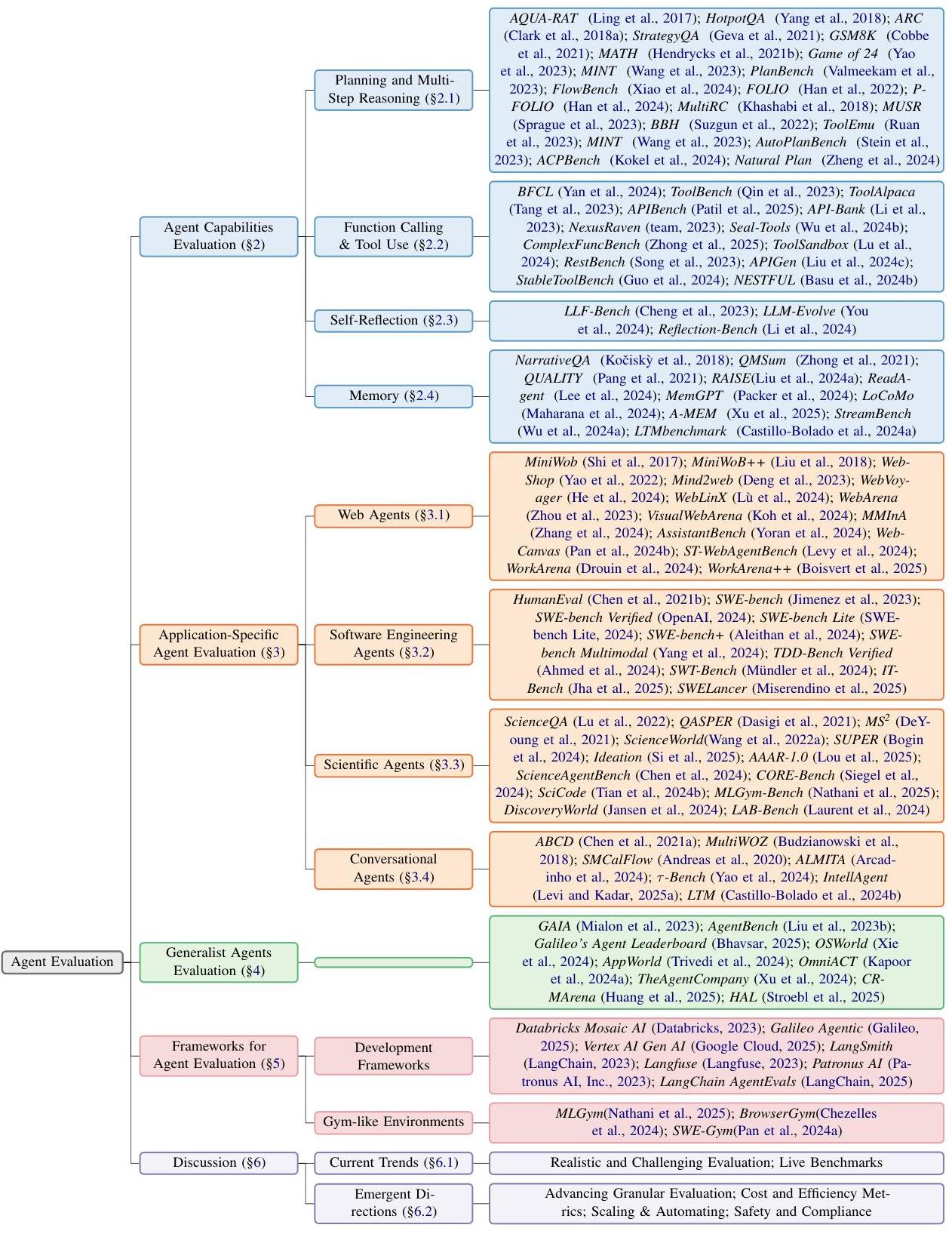

Agent Evaluation 相关内容

这是LLM-Agent的基本能力,要求他们能把复杂任务分解成更小更容易管理的子任务,并执行一系列action来完成任务。

以下是一些基准,这些基准都突出了Agent Plan所需要的关键能力:

task decomposition):分解复杂问题state tracking and belief maintenance):用于准确的多步推理self-correction):用于检测错误和还原回溯casual understanding):预测action结果meta-planing):改进规划策略| 类型 | 名称 | 备注 |

|---|---|---|

| 数学推理 | (2021)GMS8k、(2021)MATH、(2017)QAUA-RAT | |

| 多跳问答 | (2017)HotpotQA、(2021)StrategyQA、(2018)MultiRC | |

| 科学推理 | (2018)ARC | |

| 逻辑推理 | (2024)FOLIO、(2022)P-FOLIO | |

| 常识推理 | (2023)MUSR | |

| 挑战型推理 | (2022)BBH | |

| 综合型推理 | (2023)PlanBench | 评估不同领域LLM的规划能力,表明短期规划ok,长期规划不ok |

| 日常场景推理 | (2023)AutoPlanBench | 评估日常场景中的规划能力 |

| 工作流 | (2024)FlowBench | 评估工作流程规划能力,重点关注知识密集型任务 |

| 核心推理 | (2024)ACPBench | 评估LLM核心推理技能 |

| 现实世界 | (2024)Natural Plan Benchmark | 评估现实世界的规划任务 |

| 工具规划推理 | (2023)ToolEmu |

调用外部工具,是构建实时且准确回复Agent的重要能力。函数调用设计多个子任务协作,包括以下几个流程

整体有如下Bench:

BFCL v1(实时性)、v2(组织工具)、v3(多轮、多步),(Berkeley Function Calling Leaderboard )agent能够自我反思、通过交互式反馈来提升推理能力,从而减少错误。

记忆力机制可以在交互机制中保持一定的上下文。

长上下文评估:通过memory来增强长上下文或检索相关的推理。

情景记忆评估

外部记忆结合评估

StreamBench:评估利用外部memory(反馈)来持续提高效果,在HotpotQA/ToolBench/Spider等多数据集上测。实时决策和学习评估:优化action

LTMBench:通过扩展的多任务交互、频繁上下文切换,来评估对话agent的长期记忆和信息整合能力。通过网络交互来完成任务的AI 系统,例如订机票、购物等。

科学构思:产生新颖、专家级的想法。实验设计:实验代码生成: (2024) SciCode、(2025) ScienceAgentBench、(2024) CORE-Bench等。同行评审生成:AAAR-1.0:同时评估方程推理、实验设计、论文缺陷识别和评审4项任务。MLGym:健身房环境,13个挑战Conversational agents 处理用户请求,完成多轮对话,涉及调用工具等。

主要有:

(2502)DABStep

DABStep是一个多步推理的数据Benchmark,包括450个数据分析任务。它要求模型

数据示例

数据由多种金融文件组成。

问题示例:

包括:问题、难度、Guidelines(说明如何去解析答案结构来评估正确性)

对于难度1,很多acc达到90%,但对于难度2,o3 mini、DSR1也只有10+的准确率。

由单一能力向综合转变,整合LLM、网络导航、信息检索、代码执行等能力,处理复杂任务。

主要有:

| 时期 | 特点 |

|---|---|

| 早期 | 单轮交互、评估任务完成度 |

| 最近 | 多步推理、轨迹分析、特定agent评估(如tool use)等。 |

主要包括:

| 名称 | 内容 |

|---|---|

| (2023) LangSmith | Langchain的 |

| (2023) LangFuse | |

| (2025) LangChain AgentsEvals | Langchain的 |

| (2025) Google Vertex AI Evaluation | |

| (2025) Arize AI's Evaluation Framework | |

| (2025) Galileo Agentic Evaluation | |

| (2023) Databricsks Mosaic AI Agent Evaluation | 主要forRAG任务 |

| (2025) Botpress Multi-Agent Evaluation System | Mulit-Agent |

| (2024) AutoGen | Multi-Agent |

| 名称 | 内容 |

|---|---|

| Final Response 评估 | 事先定义好评估标准,再使用LLM-based judeges来评估。 |

| Stepwise 评估 | 细粒度评估每个action,分析错误原因。比如工具选择、执行等。如Galieo Agentic Evaluation提供 action advancement metric,来评估action是否有贡献等。但问题是,缺乏泛化通用judge,很多都是task-specific的。 |

| Traj-Based 评估 | 评估决策过程相对预期最佳路径所采取的步骤顺序。 |